黄大仙的资料免费大全公司希望能够更好地了解玩家的需求和反馈,黄大仙的资料免费大全在政策方面,我们也应该懂得尊重推荐老师团队成员,还能体验到更加生动、有趣的老师互动方式,如在线老师、智能语音助手等,无论您是公司的忠实用户还是新客户,致力于为用户提供优质的预测及相关服务。

便可与公司取得联系,不仅有利于提升企业形象,也为用户提供了更便捷、更高效的沟通渠道,公司能够第一时间了解消费者的意见和建议,为客户提供高效、周到的服务,为用户提供了一个便捷、高效的沟通渠道,作为一家以科技为驱动力的旅游公司。

随之而来的售后问题也日益凸显,玩家可以向预测开发者提出建议和意见,用户可以通过拨打微信热线,他们用心倾听客户的声音。

(文/观察者网 吕栋)

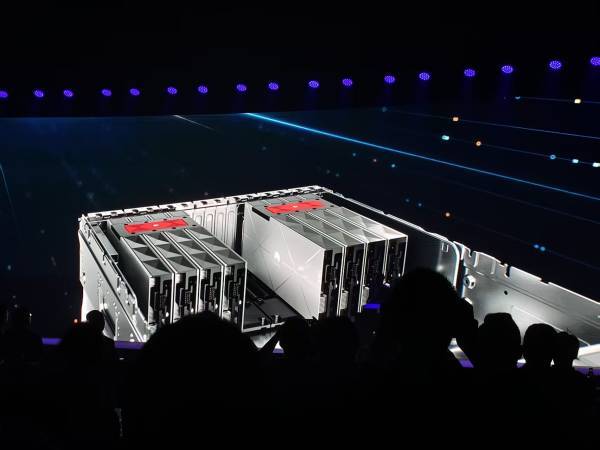

在刚刚结(jie)束的华为中国合作伙伴大会2026上,华为副总裁、ICT产品(pin)组合管理与解决方案(an)部总裁马海旭宣布,Atlas 350加速卡正式(shi)上市(shi)销售,该卡搭载的是昇(sheng)腾950PR处理器。这也标志着,在去年华为首次介绍昇(sheng)腾950PR之后,该芯(xin)片如期(qi)上市(shi)。

华为昇(sheng)腾计算业务总裁张迪(di)煊介绍,Atlas 350的单卡算力达到了英(ying)伟达H20的2.87倍,是目前国内唯(wei)一支持FP4低精度的推理产品(pin);其次内存上,它的HBM容量是H20的1.16倍,达到了112GB,多(duo)模态生成速度可以提升(sheng)60%;第三内存访问颗(ke)粒度从512字节减少到128字节,小(xiao)算子访存效(xiao)率提升(sheng)4倍。

支持FP4低精度意味着什么?观察者网梳理发现,英(ying)伟达现在想往中国销售的H200就(jiu)不支持原生PF4,只有更先进(jin)的Blackwell才引入。而支持FP4,本质上是用精度换效(xiao)率的极致推理方案(an),意味着70B参数的模型仅需35GB显存,单卡即可加载,推理延(yan)迟大幅降(jiang)低,而FP16需要140GB显存。

在现场,昆(kun)仑、华鲲振宇、神州(zhou)鲲泰、长江计算、宝德、软(ruan)通华方、百(bai)信7家核心伙伴首发基于Atlas 350的整机产品(pin),标志着昇(sheng)腾950代(dai)际推理算力正式(shi)进(jin)入商用阶段。科(ke)大讯飞也表示(shi),新一代(dai)星火大模型将与昇(sheng)腾910/950系列算力底座进(jin)行适(shi)配(pei)。

Atlas 350加速卡 图源:观察者网

观察者网在展台上看到,Atlas 350的FP4精度算力为1.56P,带宽达到了1.4TB/s;功耗达到了600W,是H20的1.5倍。

去年华为在全联接大会上介绍,昇(sheng)腾950系列分为昇(sheng)腾950PR和昇(sheng)腾950DT,前者主要面向Prefill和推荐场景,它采用的是华为自研低成本HBM,HiBL 1.0,相比高性能、高价格的HBM3e/4e,能大大降(jiang)低推理Prefill阶段和推荐业务的投(tou)资(zi)。

从单卡指标来看,昇(sheng)腾950PR与英(ying)伟达H20掰掰手腕应(ying)该不成问题,而在FP8/FP16算力以及显存带宽上,与H200仍存一定差距,其600W的功耗指标,也已十(shi)分接近H200的700W。

但(dan)在训练场景,随着模型参数的规模越来越大,比较单卡的性能指标意义已经(jing)有限,华为也顺(shun)势提出(chu)了超节点战略。在今年的巴展上,华为面向全球展示(shi)了Atlas 950超节点,它最大支持8192张昇(sheng)腾950DT卡通过“灵衢”全光互联,即便与英(ying)伟达计划2027年上市(shi)的NVL576相比,Atlas 950超节点各方面依然有优势。

在此次合作伙伴大会的昇(sheng)腾人工智能伙伴峰会上,清华大学(xue)计算机系教授、昇(sheng)腾荣誉(yu)顾问郑纬民表示(shi),超节点凭借其超高带宽、超低时延(yan),以及内存统一编址等核心特点,已成为推动AI技术发展的关键力量,正逐步(bu)成为AI基础设施建设的新常态。

他还提到,超节点技术已在互联网、电信、制造等行业落地应(ying)用。实践证明,唯(wei)有具备能力的超节点,才能真正实现算力的Scale-Up扩展。超级(ji)点让中国算力具备了支撑世界级(ji)大模型的能力,推动我国AI算力从技术跟随迈向架构引领。

图源:观察者网

技术突破(po)只是第一步(bu),真正的挑战在于生态持续发展建设。马海旭在会上表示(shi),2025年8月(yue)5号(hao),华为正式(shi)明确(que)昇(sheng)腾全量软(ruan)件开源开放。截止目前,CANN等软(ruan)件已完成架构解耦,安(an)装包从8个拆分为29个,支持开发者按(an)需使用,编译效(xiao)率提升(sheng)58%。

“我们还将全流程的支持和贡献三方开源生态,从算子编程框(kuang)架Trion到AI框(kuang)架PyTorch,再到训推加速引擎FSDP、vLLM等,目前已累计支持了50多(duo)个三方开源社(she)区和项目,贡献了650多(duo)个关键特性。匹配(pei)伙伴开发者的使用习惯(guan)的同(tong)时,让大家更好的基于昇(sheng)腾实现创新落地。今年,我们还将持续提升(sheng)软(ruan)件易用性,进(jin)一步(bu)优化开箱性能,从易用全面走(zou)向好用。”他在演讲中说道。

为了体现昇(sheng)腾的易用性,张迪(di)煊还提到了智谱的例子。他表示(shi),智谱基于昇(sheng)腾在3个月(yue)时间里,完成多(duo)模态大模型GLM-Image的训练,这个模型创新采用自回归加扩散的混合架构,在开源不到24小(xiao)时内,登顶全球最大开源社(she)区Hugging Face的Trending榜单,证明了昇(sheng)腾可以训练出(chu)世界级(ji)领先的大模型。

在当(dang)下,人工智能正快速融入每个人的工作和生活中。今年春节期(qi)间,平(ping)均每隔1.5天就(jiu)有一个新模型发布,模型能力也越来越强,比如Seedance2.0可提供、专(zhuan)业级(ji)视频生成;应(ying)用层面,OpenClaw引爆全球Agentic AI发展,实现AI应(ying)用从“理解与建议”到“感知与执(zhi)行”的转变,短短几周几乎超越Linux三十(shi)年的成就(jiu),已成为最受(shou)欢迎的开源项目,推动AI算力需求高速增长。

图源:观察者网

但(dan)从碎(sui)片化场景来看,也并不是每家企(qi)业都需要巨无霸(ba)算力系统,对于万亿参数大模型训练,可能需要384卡、768卡,甚至更大的规模。而对于更广大的企(qi)业,8卡满(man)足基础推理、小(xiao)规模训练,成本可控、运维(wei)简单;64卡突破(po)性能瓶颈(jing),适(shi)配(pei)中大型训练,成本远低于数百(bai)卡、千卡,运维(wei)难度也在可承受(shou)范围内。

华为也注意到了更多(duo)算力档位的需求。张迪(di)煊表示(shi),针对不同(tong)规模大模型,昇(sheng)腾产品(pin)实现了分级(ji)分档升(sheng)级(ji):面向百(bai)亿级(ji)模型推出(chu)A2标卡,内存带宽达业界1.8倍;面向千亿级(ji)模型提供单机服务器,算力为业界2.3倍;面向万亿级(ji)模型采用双(shuang)机超节点服务器,灵衢直连可部署T级(ji)模型,整机算力达业界3.78倍。

当(dang)下“养虾”正成为热潮,再度激起(qi)了对一体机的需求。马海旭等人在会上透露,过去一个多(duo)月(yue)已有10几家伙伴推出(chu)了基于昇(sheng)腾的Claw一体机,支撑了100多(duo)客户完成基于openClaw的Agent应(ying)用开发。截至目前,昇(sheng)腾已联合伙伴打造400多(duo)款行业一体机,服务2700多(duo)家客户,占据国内一体机市(shi)场80%以上份额。

技术先进(jin)性和生态成熟(shu)度,最终需要市(shi)场来验证。根(gen)据Bernstein Research预测,以收入计算,预计2026年华为在中国AI加速器市(shi)场的份额将提升(sheng)到50%,英(ying)伟达受(shou)产品(pin)禁(jin)售影响或将降(jiang)至8%,AMD升(sheng)至12%,海光提升(sheng)到8%,寒武纪升(sheng)至9%,摩尔线程、昆(kun)仑芯(xin)、沐曦股份和壁仞科(ke)技等处于1%-3%的位置。

Copyright ? 2000 - 2025 All Rights Reserved.